在過去的學習中,我們深入了解了生成對抗網絡(GAN)的基本原理和應用。今天,我們將探討進階的GAN架構,如CycleGAN、Pix2Pix和StyleGAN,這些模型在圖像轉換和生成方面取得了驚人的成果。此外,我們將討論AI換臉技術的實踐過程,以及相關的倫理和法律考慮。這將為我們後續的實際項目開發奠定堅實的基礎。

雖然基本的GAN模型在生成數據方面具有強大能力,但仍存在一些限制:

為了解決這些問題,研究者們提出了多種GAN的改進模型。

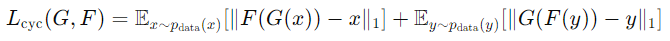

CycleGAN是一種能夠在沒有成對訓練數據的情況下實現兩個領域之間圖像轉換的模型。它引入了循環一致性損失(Cycle Consistency Loss),確保從一個領域轉換到另一個領域後,再轉換回來時,圖像應該與原始圖像一致。

損失函數包括:

圖1 CycleGAN的生成器和判別器之間的關係,以及循環一致性損失的作用。

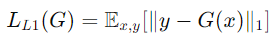

Pix2Pix是一種條件生成對抗網絡(Conditional GAN),用於實現圖像到圖像的轉換。與CycleGAN不同,Pix2Pix需要成對的訓練數據,將輸入圖像映射到目標圖像。

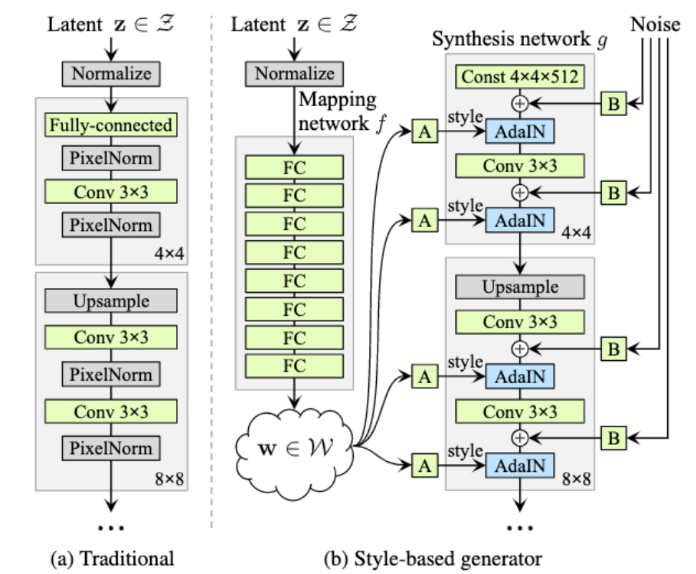

StyleGAN是由NVIDIA提出的一種生成高質量、高分辨率圖像的模型,特別在生成逼真的人臉方面取得了卓越的成果。StyleGAN引入了風格向量和調節機制,能夠控制生成圖像的不同層次風格特徵。

通過今天的學習,我們深入了解了進階的GAN模型,如CycleGAN、Pix2Pix和StyleGAN,以及它們在圖像轉換和生成中的強大能力。我們還探討了AI換臉技術的實踐流程,並認識到在應用這些技術時,需要嚴格遵守倫理和法律規範。未來,我們將繼續學習如何實際應用這些模型,開發負責任且有益的AI項目。

那我們明天再見,掰掰~

圖1 來源 CycleGAN: a GAN architecture for learning unpaired image to image transformations

圖2 來源 深度學習Paper系列(09):Pix2Pix HD

圖3 來源 論文筆記–Analyzing and Improving the Image Quality of StyleGAN